9.4 TV방송 카메라 헤드(Camera Head)

과거 촬상관 대신 이미지소자로 오늘날 많이 알려진 CCD(Charge-Coupled Devices)와 CMOS(Complementary Metal Semiconductor)로 카메라의 렌즈뭉치를 통하여 들어온 피사체의 광학적인 영상신호를 전기적인 영상신호로 바꾸어주는 역할을 한다.

과거에 많이 사용되던 대표적인 이미지 촬상관은 비디콘(Vidicon), 플럼비콘(Plumbicon)과 새티콘(Saticon) 등이 있었다. 물론 피사체의 빛이 들어와 프리즘을 통하여 3 방향으로 나누어져 R, G, B 각각의 CCD나 CMOS에서 전자적인 영상신호를 얻게 구성된 고급 카메라와 오직 1개의 CCD나 CMOS를 사용하는 베이어(bayer)방식을 채택한 경우도 많다.

이러한 전자적인 영상신호는 프리앰프(Pre-amp)에서 1단계 증폭하고 완성된 영상을 카메라 케이블을 통하여 HDCU(HD Camera Control Unit)로 보내져 최종적으로 완성된 TV방송 영상이 만들어진다.

9.4.1 프리즘(Prism)

오늘날 3판식 CCD 또는 CMOS를 사용하는 고급 카메라는 렌즈의 바로 뒤에 3색(R, G, B) 분해형 프리즘을 설치하고 각각의 광학적인 영상신호를 전자적인 영상신호로 변환시켜 디지털 영상신호로 사용된다.

프리즘의 구조는 제작회사에 따라서 조금씩 차이가 있으나 공통적인 것은 R, G, B 신호를 얻기 위하여 렌즈를 통해 투사된 피사체의 빛(Incident Light)을 프리즘을 이용해 적색(Red)과 청색(Blue)신호를 각각 13°, 25°로 반사시켜 얻고, 나머지 Green 신호는 프리즘의 영향을 받지 않고 곧바로 얻어 낸다.

이 프리즘에서 얻어지는 컬러는 피사체에서 빛의 반사특성으로 색상(色相), 채도(彩度), 명도(明度)의 3요소를 갖는다. 이 중 명도를 휘도(Luminance)라고 하고, 색상과 채도를 합쳐 색도(Chromaticity)라고 한다.

휘도는 영상의 명암정보를 나타내는데 보통 녹색신호가 색도와 휘도신호를 동시에 얻을 수 있을 만큼 강하기 때문에 휘도신호는 녹색(Green)에서 얻는다. 이 휘도신호는 컬러영상의 명암뿐만 아니라 해상도를 높이기 위하여 윤곽보상에 필요한 신호로도 사용된다.

그림 9-2 3CCD 프리즘 구조

9.4.2 영상의 이미지소자

현재 영상 이미지의 전자결합소자로 CCD와 CMOS가 사용되는데 CCD는 1985년경부터 생산되기 시작하여 처음에는 픽셀(Pixel: 화소)수가 적어 일반 가정용 카메라에 장착되기 시작하였지만 오늘날 기술의 발달로 전문적인 카메라까지 모든 분야로 사용 범위가 확대됐다.

▲ 이미지소자의 장점

① 작게 만들 수 있는 소형이다.

② 견고하고 수명이 길다.

③ R, G, B 간의 색상 오차조정(Registration) 등 동작 특성이 안정돼 있다.

④ 강한 빛에서도 흑화 현상, 백화 현상이 아주 미약하다.

⑤ 잔상이 거의 없다.

이러한 장점을 가지고 있는 CCD는 여러 가지 방법에 의해 영상신호를 만들어 낸다. 해상도의 전송이 매우 중요하게 여겨지면서 영상신호의 전송방법으로

① 행간 전송(IT: Interline Transfer)형

② 프레임 전송(FT: Frame Transfer)형

➂ 프레임 행간(FIT: Frame Interline Transfer)형 등이 개발돼 있다.

요즈음은 주로 프레임 행간(FIT: Frame Interline Transfer)형 CCD를 상용하는데 행간 전송(IT: Interline Transfer)형과 프레임 전송형의 장점을 살려 만들어진 것으로 그 활용 범위가 넓다. 쉽게 말해서 IT방식에 Frame Buffer Memory가 결합된 상태라고 할 수 있다.

소니회사는 1990년 Hyper HAD(Hole Accumulated Diode) CCD의 개발로 고감도이면서 스미어(Smear)현상을 현격히 줄일 수 있게 했고, 1998년에는 Power HAD CCD를 개발해서 감도를 한층 높여 고급 영상카메라로 사용했다.

고감도 실현을 위해 각 포토센서 위에 마이크로 렌즈를 설치하여 빛이 보다 효율적으로 유도되도록 하여 CCD의 빛을 수집하는 능력을 향상시킨 것으로 이 렌즈를 OCL(On Chip Lens)이라고 했다.

2001년에는 Power HAD EX CCD를 개발하여 고감도를 실현하고 스미어 현상을 극도로 낮추었다. 2005년에는 Power HAD EX HD CCD를 개발해서 HDTV용 카메라로 1080/60p 실현을 할 수 있게 했다.

과거 촬상관의 연속적인 주사방법과는 달리 CCD는 근본적으로 한꺼번에 전체 전하 묶음의 배열을 바꾸어 버리는 기억소자전환 구조이다. CCD는 화소(畵素: Pixel), 즉 영상을 구성하는 요소들의 계산, 각 화소의 폭, 전기적인 저역 필터, 표본과 보존회로 등등의 관심을 끄는 주요한 부분이 많다. 이 화소들은 복잡한 반도체이며, 그 디자인은 화소 수를 증가시켜 해상도를 높일 수 있도록 부단히 노력하고 있다.

CMOS 이미지 센서의 배열 자체는 영상 이미지의 휘도에 민감하다. 첫 번째는 충분한 포화전하량을 축적할 수 있는 포토다이오드를 설계하는 것이었고, 두 번째는 축적된 전하를 고속으로 전송해, 출력전압으로 판독하는 능력이다.

이 이미지 센서의 픽셀수가 많고, 60프레임의 순차주사(Progressive)방식으로 판독할 필요가 있는 경우 문제가 생긴다. 이를 극복한 새로운 이미지 센서의 개발이 관건이다.

이 이미지 센서는 초당 최대 60프레임의 내부 이미지 캡쳐(image capture) 속도로 표준 1920(H) X 1080(V)의 순차주사를 스캔하는 방식으로 R : G : B = 4 : 2 : 2의 비율로 고화질 비디오 컴포넌트 출력을 제작하기 위해 설계된다.

시네마 영상을 제작하기 위한 UHD영상이라고 해서 4K DCI(Digital Cinema Initiative)라고 하는데 이는 4096(H) x 2160(V)의 해상도를 갖는다. 일반적인 UHDTV방송 영상으로 3840(H) x 2160(V)이 있다.

<표 9-1 > CFA(Color Filter Array)에 의한 R, G, B 신호 샘플링

| 카메라 종류 | 형식 | 해상도 | sample bit | sampling (Y:r-y:b-y) | bit rate |

| PMW-200 PMW-300 |

HD | 1920x1080 | 8 bit | 4 : 2 : 2 | 50 Mb/s |

| FDR-AX1 | HD | 1920x1080 | 8 bit | 4 : 2 : 0 | 50 Mb/s |

| UHD | 3840x2160 | ||||

| PXW-Z100 | HD | 1920x1080 | 10 bit | 4 : 2 : 2 | 223 Mb/s |

| UHD | 4096x2160 | ||||

| AG-CX350 | HD | 1920x1080 | 10 bit | 4 : 2 : 2 | 200 Mb/s |

| UHD | 4096x2160 |

9.4.3 이미지 센서의 베이어(Bayer)방식 사용

베이어(Bayer)방식은 요즈음은 캠코더를 중심으로 상보형금속산화 반도체인 CMOS(Complementary Metal Semiconductor)가 빠르게 성능이 발전해 사용된다. 제작공정이 어렵지 않고 소비전력이 매우 적다는 등의 큰 장점을 가지면서 많이 활용된다.

베이어(Bayer)방식이란 프리즘에 의한 R, G, B 색분해를 위해 3 CCD를 사용하는 구조와 달리 하나의 CCD, CMOS 이미지센서를 사용하여 R, G, B의 정보를 얻을 수 있도록 고안된 방법이다.

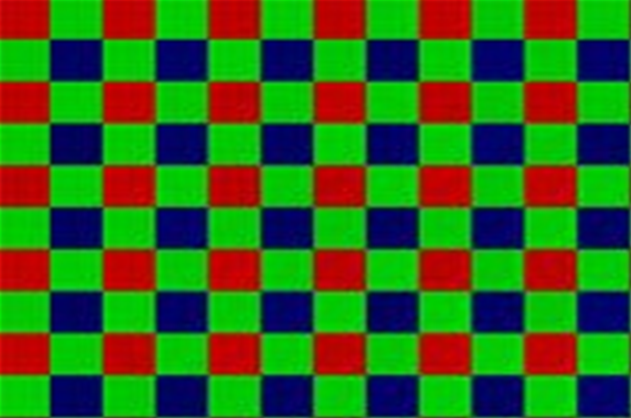

베이어(Bayer)방식은 그림 9-2에서 알 수 있듯이 이미지 센서의 각 픽셀(Pixel)에 R, G, B 필터를 부착하여 색상정보를 얻어낸다. 이런 베이어방식이 매우 발달하여 요즈음 영상 캠코더나 스틸 카메라 등에서 많이 활용되고 있다.

그림처럼 수평주사의 한 Line의 픽셀은 Red과 Green의 연속이고, 다음 Line에서는 Green와 Blue의 연속성을 갖는다. 이렇게 반복되는 각각의 픽섹(pixel)들은 R, G, B 중 하나의 색상만을 기록할 수 있도록 되어있지만 2 줄을 함께 분석해 보면 Red와 Blue 색상은 하나씩이지만 Green 색상을 보면 2배가 된다.

이렇게 만든 이유는 모든 피사체의 색상영역에서 Green이 가장 넓게 분포되어 있기 때문에 2배로 얻어내기 위함이다. 다시 말해서 Green색상이 3판식 이미지 센서에서 확인할 수 있듯이 가장 충실하게 색상을 얻어내 컬러의 휘도신호의 중심이 되도록 하기 위함이다.

그림 9-3 CFA(Color Filter Array)에 의한 RGB 분해

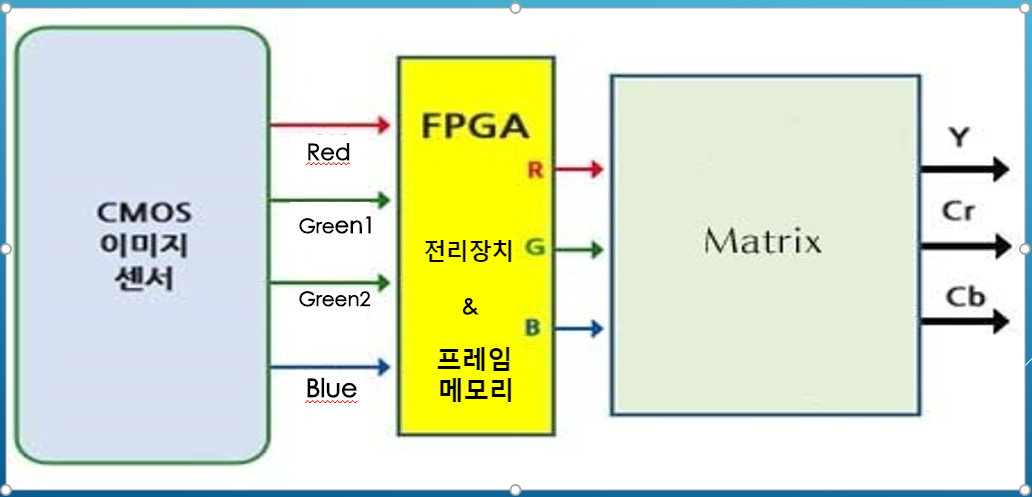

이런 베이어방식의 배열에서 얻어진 데이터를 RAW파일이라 부르고 있는데, 이 RAW파일은 우리가 알고 있는 영상으로 변환하기 위한 처리단계에서 꼭 필요하다. 마치 과거 필름에 담겨진 영상을 현상하는 것과

같은 이치로 처리 한다. 영상 처리공정에서 우리가 알고 있는 그래픽파일의 포맷으로 변환하기 위하여 기본적으로 다음과 같은 처리과정을 거치고 있다.

※ FPGA(Field Programmable Gate Array): 설계가능 논리소자와 프로그래밍이 가능한 내부회로가 포함된 반도체소자

White Balance, Color Interpolation(컬러보간법:CI), Gamma 변환, Color correction 등등으로 처리가 되어야 비로소 디스플레이 가능한 8 bit, 또는 12 bit의 R, G, B 데이터가 얻어진다.

CMOS 이미지 센서에서 컬러보간법인 CI를 거치면 모든 픽셀이 R, G, B 값을 갖게 된다. CI처리의 개념은 생각보다 간단하다. 주변의 색으로 부터 해당 픽셀이 가지고 있지 않은 색의 값을 유추해 낸다. 8 비트(bit)를 예로 들면 0, 1, 2, 3, ★, 5, 6, 7,서 ★에 해당하는 값을 우리가 4라고 유추할 수 있다.

좀 이론적으로 이해하기 어렵지만 3각 프리즘을 통해 피사체의 R, G, B 또는 Y, B-y, R-y 3개의 영상으로 나누어 디지털신호로 변환 처리하는 방식과 베어(Bayer)방식에 의해 같은 결과를 얻어낼 수 있다는 정도로 이해하면 될 것이다.

9.4.4 카메라 뷰파인더(Camera Viewfinder) 시스템

카메라에 들어오는 영상의 확인 작업을 위한 전자적 뷰파인더는 크게 2가지로 나누어져 있다. 아이피스(Eyepiece)용과 액정(LCD) 모니터가 있다. 스튜디오 카메라용으로 많이 쓰는 뷰파인더는 카메라 헤드(Head)의 상단에 부착되어 영상화면 구도와 초점을 확인하는 약 5인치, 7인치 크기의 컬러 모니터다.

과거 흑백 TV모니터를 주로 사용하는 중요한 이유는 컬러 모니터보다 해상도가 좋고, 값이 싸고, 장기간 사용하면서 시력을 보호한다는 의미도 있다. 그러나 요즈음은 액정(LCD)용 모니터가 소형화로 제작되면서 아이피스용과 컬러 뷰파인더가 장착되는 경향이 많다.

스튜디오 카메라를 제외하고 이동용 카메라에서는 그 크기가 작아야 하고 카메라의 옆에 부착하여 사용하기 편리하여야 함으로 약 1.5인치, 1.35인치, 2인치 정도의 아이피스 뷰파인더를 설치하고 있다.

일체형 카메라는 촬영하고 결과를 확인하는 작업까지 할 수 있게 하고 있어 오늘날 액정 모니터의 발전은 아이피스와 동시에 컬러 형태로 영상화면 구도를 확인할 수 있도록 사용되는 카메라 모니터들이 속속 등장한다.

ENG 카메라의 아이피스 뷰파인더는 눈을 직접 부착시켜 외부의 빛을 차단하고 시도(視度) 조절기를 좌우로 돌려 각자의 시력에 맞춰 영상화면을 명확히 볼 수 있게 하고, 뷰파인더의 밝기를 조절하여 눈의 피로를 피하도록 한다.

또한 대부분의 뷰파인더는 통신 수단으로 카메라가 동작 중일 때 카메라 상태나 기능 정보를 전해 주어 카메라맨의 워킹을 도와준다. 실제 어떻게 무엇을 나타내주는가는 조금씩 다르지만 대체적으로 다음과 같은 정보를 전달한다.

1. 카메라의 설정 상태 표시: 녹화 시간, 테이프 잔량, DC 전압, Audio Level, White Balance Mode, Filter 종류, 셔터 속도, Gain, Zebra 등등의 정보

2. 영상화면 구도(Zone) 표시: 영상화면 크기, 안전지역(Safety Zone), 중앙 표시(Center Marker), 영상화면 비율(4:3 또는 16:9) 등등

3. 탈리 라이트(Tally Light); 여러 카메라 중 선택 되어 사용 중임을 표시한다.

4. Return Video: 비디오 스위처의 출력이 연결되어 작업상황과 On Air 영상화면을 필요할 때 항시 볼 수 있다. 상대편의 카메라 구도를 관찰하고 샷의 크기를 통일할 수 있도록 정보를 얻고, 부조정실의 작업 상황을 수시로 파악하여 스튜디오 작업을 준비하고 확인도 한다. 다른 카메라나 다른 영상과의 합성작업 상황도 쉽게 파악할 수 있다. 본 카메라 영상과 비디오 이펙트 처리는 어떻게 어떤 연관을 가지고 실행되는지 확인할 필요가 있다.

5.기타: 타임코드, 습기와 결로 상태, 연결된 레코드의 재생 모니터, 스튜디오 카메라는 비디오 담당자와의 연락 등등, 특히 소형 캠코더에는 아주 많은 사용정보를 전해 준다.

▲ Viewfinder의 조정 내용

① Brightness 조정

② Contrast 조정

➂ Peaking 조정이 있어 필요할 때마다 알맞게 조정할 필요가 있다.

9.4.5 프리앰프(Pre-amp)

카메라 본체의 CCD에서 검출된 영상신호를 1차적으로 증폭해 주는데 중요한 것은 이때 카메라의 S/N비가 결정되기 때문에 저 잡음 증폭이 결정되는 부분으로 매우 중요한 조정부위이다.

LF(Low Frequency), MF(Medium Frequency), HF(High Frequency)가 있어 되도록이면 조정을 삼가도록 하고, 다만 필요에 따라서 프리앰프에서는 이득조정(Gain Set)만을 실시하는 것이 좋다. 이렇게 얻어진 영상신호를 한 단계 더 증폭시켜주고 카메라의 영상을 완성하는 HDCU(HD Camera Control Unit)로 카메라 케이블을 통해 영상신호가 보내진다.

'TV방송 시스템운용과 영상제작' 카테고리의 다른 글

| 09. TV방송 영상 카메라(Camera)(4) (0) | 2021.06.15 |

|---|---|

| 09. TV방송 영상 카메라(Camera)(3) (0) | 2021.06.11 |

| 09. TV방송 영상 카메라(Camera)(1) (0) | 2021.05.18 |

| 08. TV방송제작의 기본적 영상문법(5) (0) | 2021.05.08 |

| 08. TV방송제작의 기본적 영상문법(4) (0) | 2021.04.27 |